Diferenças entre CPU e GPU: Qual é melhor para resolver problemas complexos?

CPU vs GPU: Qual é a melhor escolha para resolver problemas computacionais intensivos?

Quando falamos sobre desempenho computacional, especialmente em áreas como simulações físicas, inteligência artificial ou processamento gráfico, duas siglas dominam a conversa: CPU (Central Processing Unit) e GPU (Graphics Processing Unit). Mas afinal, qual delas é mais eficiente para resolver problemas científicos, de engenharia ou aplicações com alto volume de dados?

Se você é estudante, pesquisador ou profissional da área de tecnologia e ainda tem dúvidas sobre quando usar CPU ou GPU, este artigo vai esclarecer todos os pontos essenciais — com base em conceitos sólidos e aplicações reais.

1. Arquitetura e Execução: A diferença entre as instruções da CPU e GPU

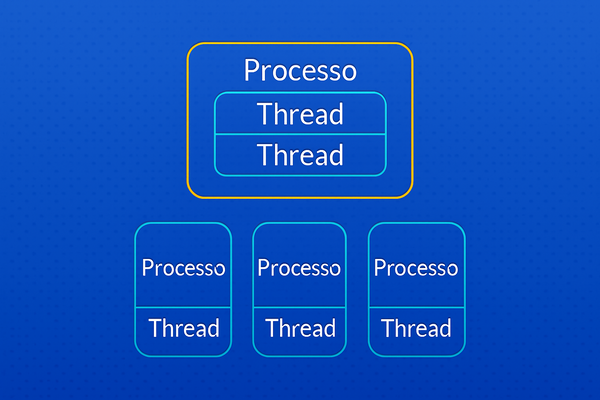

A CPU é o cérebro tradicional do computador. Seu funcionamento é baseado no modelo Single Thread, Multiple Instructions (STMI). Isso significa que, apesar de possuir múltiplos núcleos, ela executa uma única thread por núcleo, que pode realizar diferentes instruções em sequência. A CPU é otimizada para flexibilidade e controle, e sua arquitetura permite lidar com uma ampla gama de tarefas, inclusive aquelas que exigem decisões lógicas complexas e acesso aleatório à memória.

Já a GPU foi projetada com outro propósito: paralelismo massivo. Sua arquitetura segue o conceito de Single Instruction, Multiple Threads (SIMT). Nesse modelo, várias threads executam a mesma instrução ao mesmo tempo, em milhares de núcleos leves e organizados em blocos. Isso torna a GPU extremamente eficiente em tarefas que podem ser paralelizadas, como operações matriciais, transformações geométricas ou a resolução de equações diferenciais parciais em malhas tridimensionais.

Por isso, enquanto a CPU executa threads de forma sequencial e com controle detalhado, a GPU executa centenas ou milhares de threads simultaneamente com a mesma instrução.

2. Throughput vs. Latência: Eficiência em diferentes contextos

Outro aspecto fundamental é a comparação entre latência e throughput.

- Latência é o tempo necessário para completar uma única tarefa.

- Throughput é a quantidade de tarefas que o sistema consegue executar por unidade de tempo.

A CPU tem baixa capacidade de throughput, mas apresenta baixa latência por tarefa individual. Ou seja, é rápida e precisa para tarefas complexas isoladas.

Por outro lado, a GPU tem alta capacidade de throughput. Ela pode resolver milhares de tarefas simples ao mesmo tempo, mesmo que cada uma leve mais tempo individualmente. Portanto, sua latência por tarefa pode ser maior, mas o volume de dados processados por segundo é muito mais alto.

Essa distinção é essencial na hora de escolher o hardware para o seu problema. Um exemplo prático:

- Para executar um código de controle de temperatura de um forno industrial, que envolve poucas variáveis e alto grau de controle lógico, a CPU é ideal.

- Para simular o escoamento de um fluido sobre a asa de uma aeronave com milhões de variáveis distribuídas em uma malha, a GPU é indispensável.

3. Quando usar CPU e quando usar GPU: O papel dos graus de liberdade

O número de graus de liberdade de um problema é um bom indicativo de qual arquitetura usar.

- Se você está lidando com problemas com poucos graus de liberdade — ou seja, com um número limitado de variáveis a serem processadas simultaneamente — a CPU oferece o melhor desempenho. Ela pode gerenciar essas tarefas com grande precisão, utilizando seus núcleos otimizados para desempenho serial.

- Já em problemas com muitos graus de liberdade, como nas simulações numéricas em Mecânica dos Fluidos Computacional (CFD), em Análise Estrutural Não Linear, ou em Redes Neurais Profundas, a GPU é a ferramenta ideal. Isso porque ela consegue processar simultaneamente milhões de pontos ou variáveis, aproveitando ao máximo seu poder de paralelismo.

Por exemplo, um solver numérico de CFD que utiliza CUDA C/C++ pode lançar milhares de threads para resolver as equações de Navier-Stokes em paralelo em uma malha 3D. Isso seria impraticável em uma CPU, tanto por tempo de execução quanto por consumo de energia.

Conclusão: Cada ferramenta tem seu lugar — e entender isso faz toda a diferença

A escolha entre CPU e GPU não é apenas uma questão de “quem é mais forte”. É, na verdade, uma questão de adequação ao problema.

- Use CPU quando o problema exige decisões complexas, menor volume de dados ou precisão em tarefas isoladas.

- Use GPU quando há enorme volume de dados, alta paralelização e necessidade de alto throughput.

Se você trabalha com simulações computacionais, otimização de algoritmos ou desenvolvimento de software técnico, compreender essa diferença é essencial para extrair o máximo do seu hardware e obter resultados eficientes, confiáveis e escaláveis.